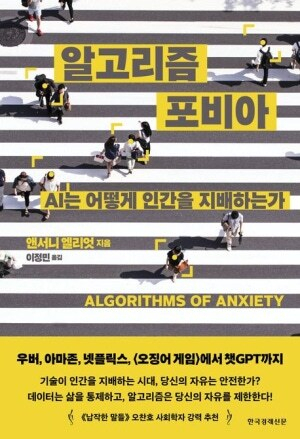

신간 <알고리즘 포비아>

신간 <알고리즘 포비아>. 한국경제신문 제공

신간 <알고리즘 포비아>. 한국경제신문 제공

로봇청소기가 집안을 촬영하며 사생활을 침해하고, 유럽의 주요 공항이 사이버 공격 한 번에 마비되는 시대. 알고리즘은 우리 삶을 윤택하게 해 줄 혁신 과학일까, 자율성을 침해하는 통제의 기술일까.

호주 사우스오스트레일리아대학교 사회학과 석좌교수인 앤서니 엘리엇은 신간 <알고리즘 포비아>를 통해 인공지능(AI)의 불편한 진실을 드러낸다. 저자는 AI 기술이 약속하는 편리함과 효율성의 그늘에 통제와 감시의 구조가 있다고 지적한다.

우버 운전사 알렉산드루의 경우를 예로 들어 자동화된 평가 시스템의 오류로 하루아침에 노동자가 해고될 수 있는 어이없는 현실을 꼬집는다. “시스템이 잘못됐을 리 없다”는 사측의 해명은 얼핏 공정해 보일 수 있지만 실제로는 책임 없는 감시 체제로 인간을 통제하는 알고리즘의 모순을 드러낸다. 이 사건을 통해 저자는 현대사회의 통제 방식이 자동화된 권력으로 변모했음을 보여준다.

넷플릭스의 추천 콘텐츠 시스템은 기술이 감정 구조를 어떻게 조작하는지를 보여주는 사례다. 이 시스템은 단순히 취향을 반영하는 도구가 아니라 취향을 설계하는 장치가 될 수 있다. 알고리즘은 시청 이력과 반응을 학습해 시청자가 좋아할 만한 것을 제시하지만, 그 선택 경로는 이미 설계돼 있는 것이다.

SNS의 ‘좋아요’와 스티리밍 서비스의 추천 알고리즘은 인간의 친밀성을 점수로 변환한다. 인간의 정체성은 알고리즘의 추천과 예측 속에서 재구성되고, 현대인의 자아는 점점 희미해진다. 저자의 주장은 기술을 거부하자는 게 아니라, 기술이 인간을 재정의하는 방식을 자각하라는 데 있다. 앤서니 엘리엇 지음·이정민 옮김/한국경제신문/316쪽/2만 원.

이자영 기자 2young@busan.com